ollama安装

ollama安装

简介

一键运行开源大模型,非常的方便。

github:https://github.com/ollama/ollama

官网:https://ollama.com/

安装部署

推荐使用docker运行,先开启GPU的docker支持,然后直接运行:

1

2

3

4

5

6

7

mkdir /app/ollama -p && \

docker run -d \

--gpus=all \

-v /app/ollama:/root/.ollama \

-p 11434:11434 \

--name ollama \

ollama/ollama

ollama使用

运行大模型:ollama run qwen2.5:7b

查看本地大模型列表:ollama list

查看运行中的大模型:ollama ps

删除本地指定大模型:ollama rm llama3:8b-text

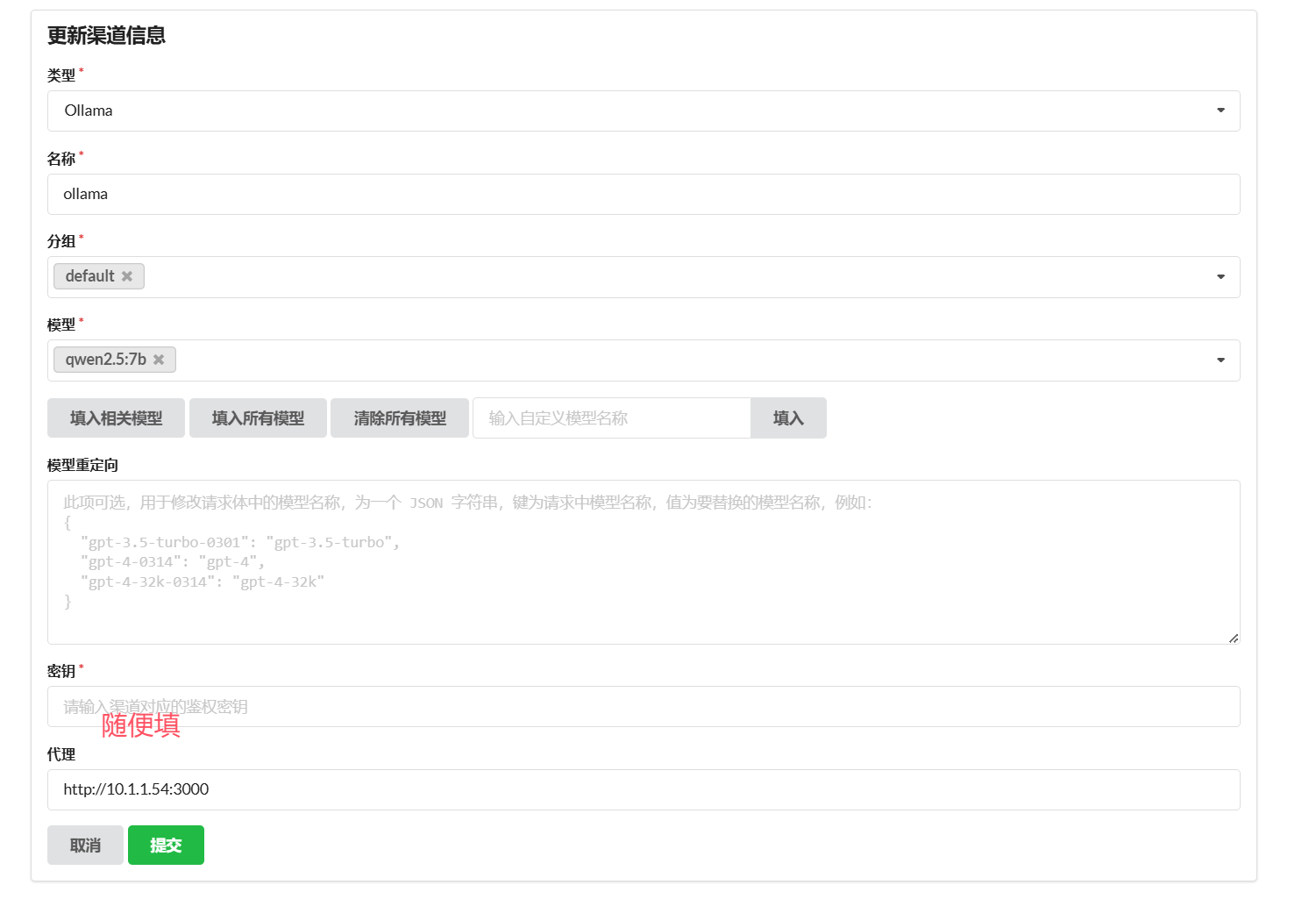

接入oneapi

配置如下:

本文由作者按照

CC BY 4.0

进行授权