部署一个自己的ChatGPT网页

部署一个自己的ChatGPT网页

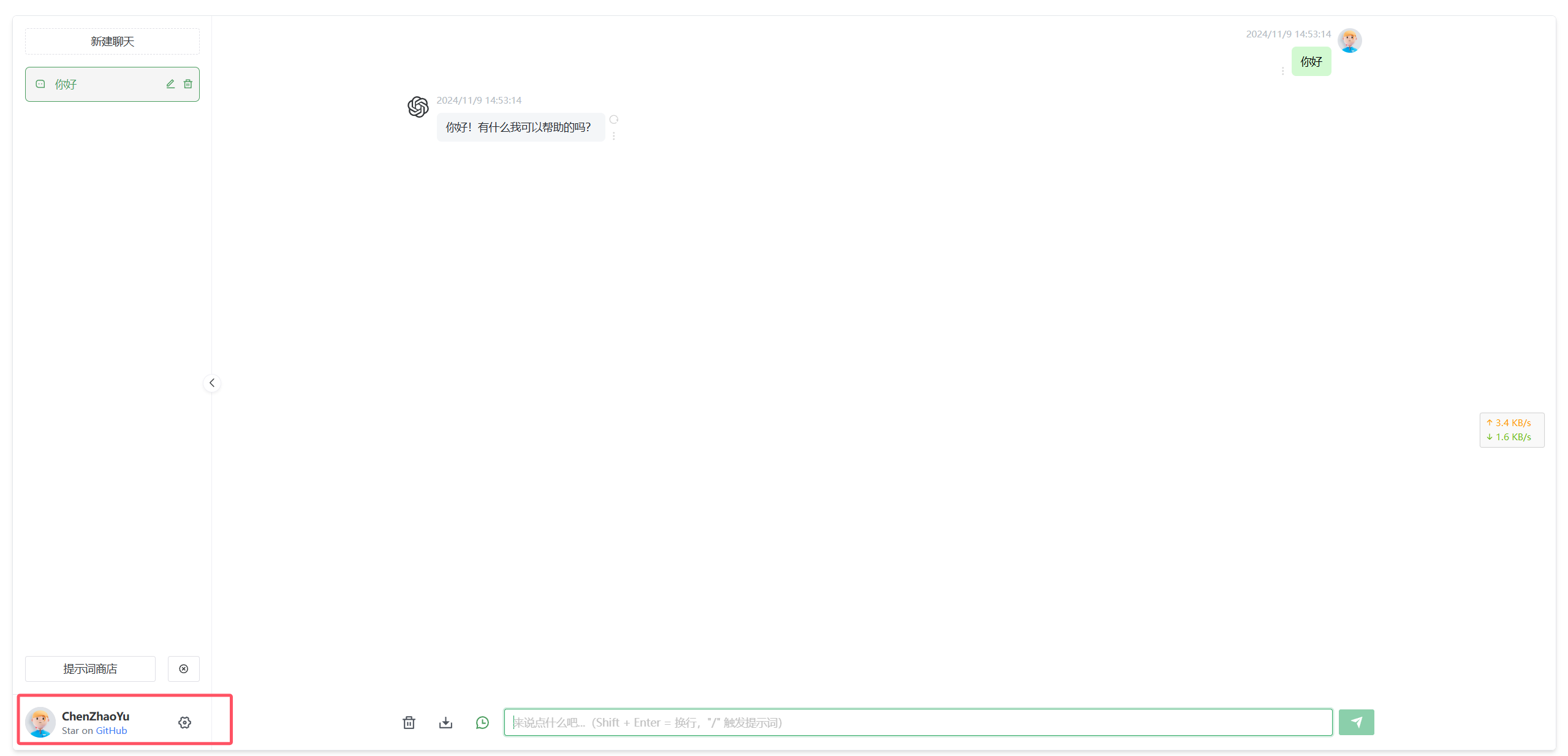

我的AI

开箱即用哈哈哈免费:https://chat.masterke.cn

chatgpt-web

Docker部署:

1

2

3

4

5

6

7

docker run -d \

-p 3002:3002 \

--env OPENAI_API_BASE_URL=https://oneapi.masterke.xyz:8443 \

--env OPENAI_API_KEY=sk-WT2C0NadrT2j1owfC9F115378c2840A8B93d1769252b53C2 \

--env OPENAI_API_MODEL=glm-4-plus \

--name chatgpt-web \

chenzhaoyu94/chatgpt-web

注意我这里用的是内网地址,你需要把你的api地址换成官方的或者其他,API-key也需要相应的替换。

左下角的默认名字可以修改:https://github.com/Chanzhaoyu/chatgpt-web/issues/663

1

docker exec -it chatgpt-web /bin/sh -c "cd /app/public/assets/ && sed -i 's/ChenZhaoYu/MasterKe/g' *.js" && docker restart chatgpt-web

重新加载网页缓存即可。

如果需要流式传输可以这样配置nginx:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

server {

listen 80;

server_name chat.masterke.cn;

location / {

return 301 https://$host$request_uri;

}

}

server {

listen 443 ssl;

server_name chat.masterke.cn;

ssl_certificate /etc/letsencrypt/live/masterke.cn/fullchain.pem;

ssl_certificate_key /etc/letsencrypt/live/masterke.cn/privkey.pem;

ssl_session_cache shared:SSL:1m;

ssl_session_timeout 5m;

location / {

proxy_pass http://127.0.0.1:3002;

proxy_redirect off;

proxy_http_version 1.1;

sub_filter_once off;

proxy_set_header Host $http_host;

proxy_set_header Referer $http_referer;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header User-Agent $http_user_agent;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header Accept-Encoding "";

proxy_set_header Accept-Language "zh-CN";

proxy_buffering off;

proxy_cache off;

}

}

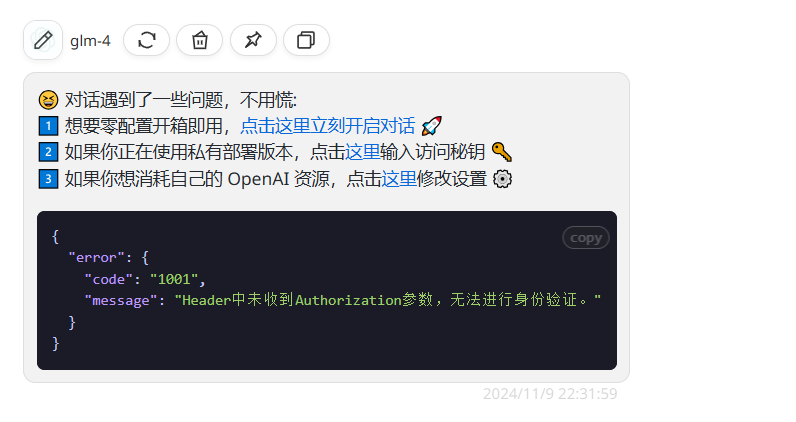

ChatGPT-Next-Web

Docker部署:

1

2

3

4

5

6

7

8

9

docker run -d \

-p 3001:3000 \

-e BASE_URL=https://oneapi.masterke.xyz:8443 \

-e OPENAI_API_KEY=sk-WT2C0NadrT2j1owfC9F115378c2840A8B93d1769252b53C2 \

-e CUSTOM_MODELS=-all,+glm-4-plus@OpenAI,+glm-4-flash@OpenAI,+gpt-3.5-turbo@OpenAI,+gpt-4@OpenAI \

-e DEFAULT_MODEL=glm-4-plus \

--restart always \

--name=chatnextweb \

yidadaa/chatgpt-next-web

注意事项

本文由作者按照

CC BY 4.0

进行授权